TensorFlow Lite aktiviert das Gehirn Eures Smartphones

Das Mate 10 Pro hat einen. Das Pixel 2 (XL) ebenfalls: Die Rede ist natürlich von einem spezialisierten Chip, der Machine-Learning-Berechnungen beschleunigt. Jetzt hat Google TensorFlow Lite als Entwicklervorschau angekündigt und die Puzzleteile des Machine-Learning-Zeitalters fügen sich langsam aber sicher zusammen.

TensorFlow Lite ist eine Programmbibliothek, mit deren Hilfe App-Entwickler Machine-Learning-Funktionen umsetzen können. Wie der Name schon andeutet, basiert sie auf dem Framework TensorFlow, das Google für die Zwecke des Machine Learnings konzipiert hat. Während TensorFlow dafür genutzt werden kann, ein neuronales Netz zu trainieren, kann TensorFlow Lite lediglich Daten mit Hilfe eines vorgefertigten Trainingssatzes verarbeiten – daher der Namenszusatz Lite.

We are so excited to announce the Developer Preview of #TensorFlowLite!

— TensorFlow (@TensorFlow) 14. November 2017

Read all about it in our blogpost → https://t.co/OhP8Z9dEiO pic.twitter.com/mI61bvD6Vm

Für App-Entwickler ist TensorFlow Lite interessant, weil die Bibliothek explizit auf die Bedürfnisse mobiler Anwendungen zugeschnitten ist. Die Größe der Anwendungen ist so gering wie möglich und TensorFlow Lite unterstützt Android und iOS. Außerdem ist TensorFlow Lite auf Performance optimiert. Zunächst handelt es sich aber um eine Vorschau-Version für Entwickler.

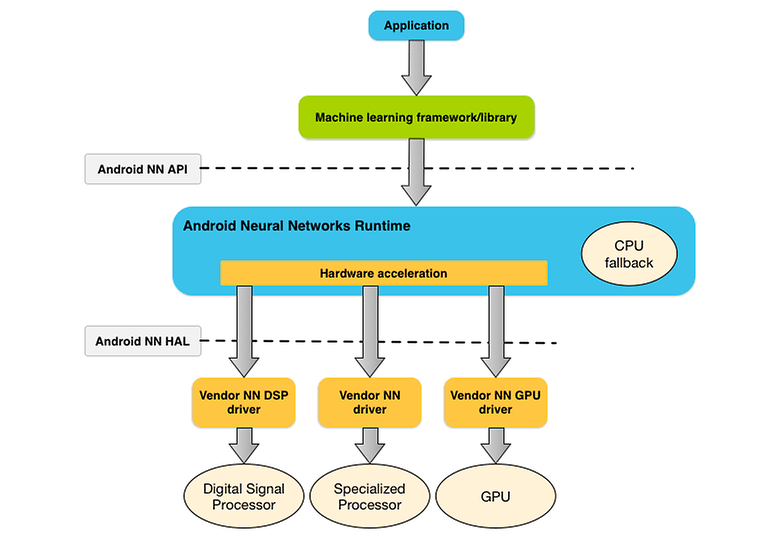

Das gelingt Google, indem TensorFlow Lite nach Möglichkeit die Android Neural Networks API anspricht. Zwar ist diese erst ab Android 8.1 Oreo verfügbar, sie erlaubt aber den Zugriff auf die bereits angesprochenen spezialisierten KI-Chips. Gibt es keinen KI-Chip, so kann die Neural Networks API versuchen, einen Signalprozessor oder den Grafikchip anzusprechen. Erst wenn das nicht gelingt, kommt die klassische CPU zum Einsatz. Google hat ein kleines Schema gezeichnet, das den Ablauf verdeutlicht:

Die klassische CPU hat aber für Machine-Learning-Anwendungen Nachteile: GPUs bzw. NPUs sind auf parallele Rechenoperationen hin optimiert. Und genau solche stehen im Zentrum von Machine Learning. CPUs hingegen sind eher für Operationen optimiert, die nacheinander ablaufen müssen. Alleine der Pixel Visual Core kann laut Google rund 3 Billionen Rechenoperationen in der Sekunde ausführen.

Wofür das alles gut ist? Zum einen gibt es künftig für Entwickler die Möglichkeit, Machine-Learning-unterstützte Apps zu entwickeln und dabei spezialisierte Hardware anzusprechen. Vorteile hat das bei Bilderkennung, zum Beispiel aber auch bei Suchanfragen. Was Entwickler aus den Möglichkeiten machen, bleibt natürlich spannend. Sicher ist schon jetzt: Künftig werden AI-Chips wichtiger Bestandteil von Smartphones werden.

-

Admin

18.11.2017 Link zum Kommentar"TensorFlow Lite aktiviert das Gehirn Eures Smartphones"

Meine Smartphones haben kein Gehirn...

Es wäre wohl besser wenn mal endlich der eine oder andere PolitikerIn sein Gehirn einschalten würde.

Das Gehirn der Politiker? Welches Gehirn? Die habe doch keins 😂 ich habe noch nie soviel sinnlose biokratie gesehen wie in Deutschland.

Ich fuehl mich immer mehr wie in den Filmen 1984 und Terminator. Ueberwachung, intelligente Maschienen, Firmen die Superchips bauen und damit den 3. Weltkrieg ausløsen. Yepp meine Paranoia lebt :-)