- Forum-Beiträge: 607

15.12.2015, 12:15:29 via Website

15.12.2015 12:15:29 via Website

Hallo Zusammen,

da ich relativ neu in der Android-Programmierung bin (VisualBasic, Java und C++ schon seit einigen Jahren) sprudel ich natürlich vor Ideen, welche ich umsetzen will. Teilweise natürlich auch, weil ich denke, dass Leute eine App kaufen könnten.

In diesem Fall geht es allerdings um eine App, welche ich aus Spaß, bzw. eigenem Interesse, programmieren möchte.

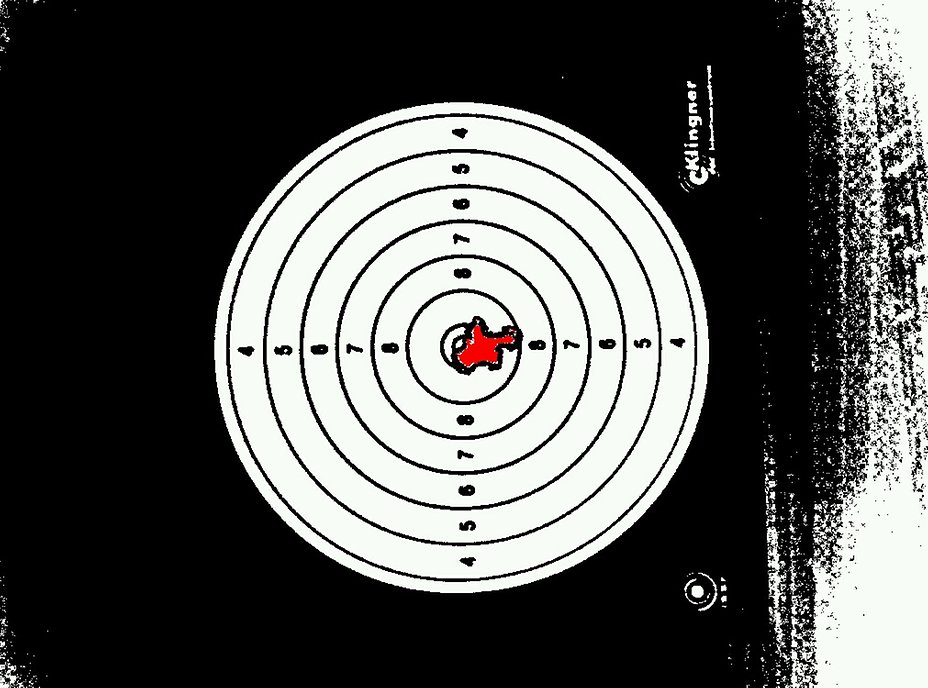

Es geht hierbei darum, ein Foto von einer "Scheibe" (Schieß-Sport) zu machen, und anschließend auszuwerten, wo die Schüsse liegen. Müsste ja möglich sein, da die einzelnen "Zähler" optisch getrennt sind, die Einschusslöcher könnte man ja als Abweichungen auswerten.

Nun meine eigentliche Frage: Wie kann ich die Pixel, oder einzelne Bereiche, eines Bildes analysieren?

Ich hoffe, damit hat schon einmal jemand Erfahrungen gemacht.

Empfohlener redaktioneller Inhalt

Mit Deiner Zustimmung wird hier ein externer Inhalt geladen.

Mit Klick auf den oben stehenden Button erklärst Du Dich damit einverstanden, dass Dir externe Inhalte angezeigt werden dürfen. Dabei können personenbezogene Daten an Drittanbieter übermittelt werden. Mehr Infos dazu findest Du in unserer Datenschutzerklärung.